东方法学特稿|王苑:具身智能体的隐私风险及法律应对——以“人形机器人”为例的展开

发布时间:2024-09-16

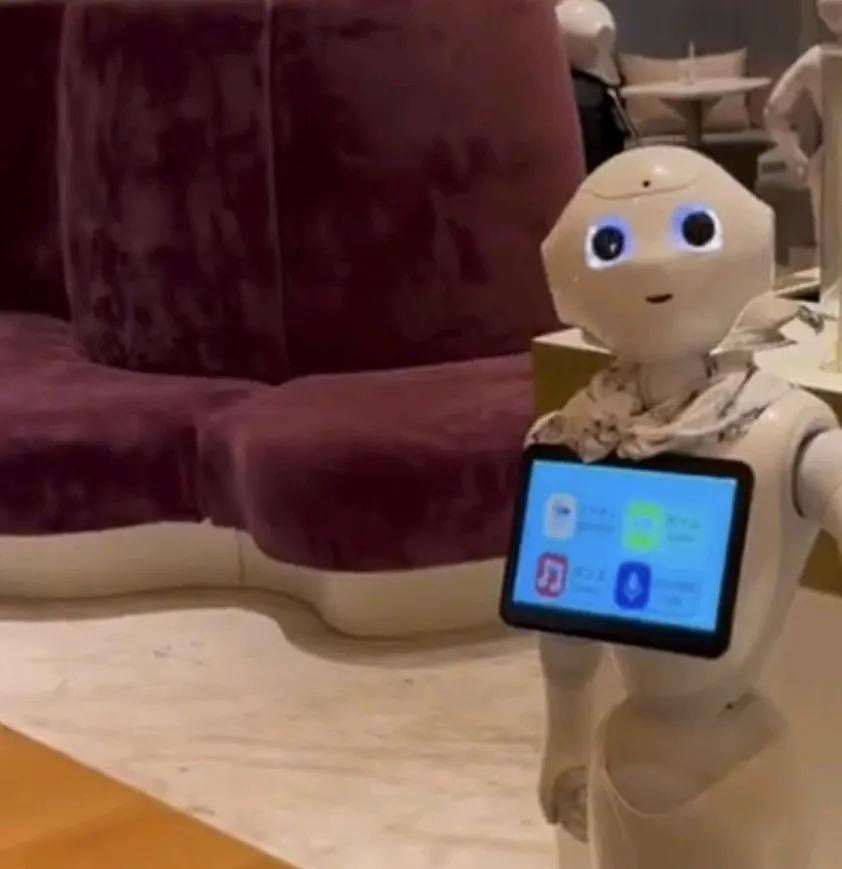

人形机器人正以前所未有的速度进入我们的生活。2024年世界人工智能大会上,特斯拉展示的“擎天柱2代”人形机器人已经能够完成煮鸡蛋等精细操作。国内企业研发的人形机器人也在多个领域展现出广泛应用前景。然而,随着人形机器人技术的快速发展,其带来的隐私风险问题也日益凸显。

作为新型的“具身智能体”,人形机器人对隐私保护提出了前所未有的挑战。与传统的非具身AI系统不同,人形机器人结合了人工智能与机器人技术,能够感知、理解环境,并通过智能决策和行动与环境互动。这种强大的互动和行动能力,使得人形机器人能够侵入私密空间,记录私密活动,并潜移默化地收集处理私密信息。

更令人担忧的是,人形机器人可能具备一定程度的自主性,能够根据环境和目标作出自主决策,并采取相应的行动。这种自主性使得追究责任变得不切实际,传统的个人信息控制机制面临失效的风险。

面对这些挑战,现有的隐私和数据保护法律框架显得捉襟见肘。传统的隐私保护规则主要围绕信息控制展开,而人形机器人数据的生成和涌现特性,加上其造成实际损害的能力,使得现有法律难以有效应对。

为了应对人形机器人带来的隐私风险,我们需要从多个方面着手:

首先,应当弱化既有数据法中个人同意的作用。在人形机器人应用场景中,个人同意往往难以实现或不切实际。我们需要探索新的隐私保护机制,如“通过设计来进行隐私和数据保护”的原则,明确设计者的责任。

其次,需要在人工智能立法中植入数据保护理念,强化监管者和设计者责任。可以考虑禁止通用型具身智能的市场化应用,以避免潜在的隐私风险。

再次,应当加强对人形机器人数据处理活动的监管。从数据的收集、存储、使用、分享、传输到销毁,都需要有明确的法律规范。特别要防范“数据污染”和“数据投毒”等恶意行为,确保人工智能决策的准确性和安全性。

最后,我们需要建立跨学科的专家团队,包括法律专家、技术专家、伦理学家等,共同探讨人形机器人带来的伦理和法律问题。只有多方协作,才能制定出既保护隐私又促进技术创新的平衡方案。

展望未来,人形机器人技术的发展势不可挡。我们需要在保护隐私和促进创新之间找到平衡点。一方面,要建立健全的人形机器人隐私保护法律体系,明确各方责任;另一方面,也要为技术创新留出空间,避免过度监管阻碍技术进步。

人形机器人的发展正在重塑我们的生活和工作方式。如何在享受技术红利的同时,有效应对隐私风险,将是未来法律和政策制定者面临的重要挑战。只有未雨绸缪,才能确保人形机器人技术的健康发展,为人类社会带来更多福祉。